# Reranker คืออะไร? คู่มือ Cross-Encoder เพิ่มความแม่นยำ RAG Search สำหรับ SME ไทย 2026

หากองค์กรของคุณกำลังสร้าง AI Chatbot, Enterprise Search หรือระบบ RAG (Retrieval-Augmented Generation) แต่พบว่าคำตอบที่ AI ให้ยัง "ไม่ตรงประเด็น" หรือมี Hallucination บ่อยครั้ง ปัญหาส่วนใหญ่ไม่ได้อยู่ที่โมเดล LLM แต่อยู่ที่ขั้นตอน Retrieval ที่ดึงเอกสารผิดบริบทเข้าไปใน Context Window ของ LLM

Reranker หรือ Cross-Encoder คือเทคนิคที่ช่วยแก้ปัญหานี้โดยตรง บทความนี้จะอธิบายว่า Reranker คืออะไร ทำงานอย่างไร แตกต่างจาก Vector Search ทั่วไปอย่างไร และ SME ไทยควรเลือกโมเดลตัวไหน (Cohere, BGE, Jina) เพื่อยกระดับ AI Search ให้แม่นยำขึ้น 20-40% โดยไม่ต้อง Fine-tune LLM

Reranker คืออะไร? ทำไมต้องใช้หลัง Vector Search

Reranker คือโมเดล Machine Learning ประเภท Cross-Encoder ที่ทำหน้าที่ "จัดอันดับใหม่" เอกสาร (document) ที่ผ่านการค้นหาด้วย Vector Search มาแล้ว โดยพิจารณาความเกี่ยวข้องระหว่างคำถาม (query) และเอกสารแต่ละชิ้นแบบ "คู่ต่อคู่" (pairwise) ก่อนส่งต่อให้ LLM ตอบ

ใน RAG Pipeline แบบดั้งเดิม ระบบจะใช้ Bi-Encoder (เช่น OpenAI Embeddings หรือ BGE-M3) แปลงคำถามและเอกสารทั้งหมดเป็น Vector แล้วค้นหาเอกสารที่ "ใกล้เคียง" ที่สุดด้วย Cosine Similarity วิธีนี้เร็วมากเพราะ embed เอกสารล่วงหน้าได้ แต่ ไม่เข้าใจบริบทเชิงลึก เพราะคำนวณ similarity จาก vector แยกกัน

Reranker ใช้สถาปัตยกรรมต่างออกไป โดย input ทั้งคำถามและเอกสารเข้าไปพร้อมกันใน Transformer จึงเข้าใจความสัมพันธ์ระหว่างคำสำคัญ (keyword interaction) ได้ลึกกว่ามาก ผลคือความแม่นยำสูงขึ้น แต่แลกด้วยความช้ากว่าอย่างมาก — จึงใช้เป็นขั้นตอนที่สอง (two-stage retrieval)

Bi-Encoder vs Cross-Encoder: ความแตกต่างที่ต้องรู้

| หัวข้อ | Bi-Encoder (Vector Search) | Cross-Encoder (Reranker) |

|-------|---------------------------|--------------------------|

| สถาปัตยกรรม | Embed คำถาม/เอกสารแยกกัน | Input คู่ query-document พร้อมกัน |

| ความเร็ว | เร็วมาก (ms/query) | ช้ากว่า 100-1000 เท่า |

| ความแม่นยำ | ดี (Recall สูง) | ดีมาก (Precision สูง) |

| Scale | ค้นจาก 1M+ docs ได้ | เหมาะกับ 10-100 docs ต่อ query |

| ตัวอย่างโมเดล | text-embedding-3, BGE-M3, E5 | Cohere Rerank, BGE-Reranker, Jina |

| ค่าใช้จ่าย | ต่ำ | กลาง-สูง |

วิธีใช้ที่ถูกต้องคือ ใช้ทั้งสองร่วมกัน — ให้ Bi-Encoder ค้น Top-K (เช่น 50-100 เอกสาร) ก่อน แล้วให้ Cross-Encoder จัดอันดับ Top-N ที่ดีที่สุด (เช่น 3-10 เอกสาร) ส่งเข้า LLM วิธีนี้เรียกว่า Two-Stage Retrieval

สถาปัตยกรรม RAG with Reranker (ขั้นตอนใช้งานจริง)

โครงสร้างระบบ RAG ที่มี Reranker ประกอบด้วย 5 ขั้นตอน

เทคนิคเสริมที่นิยมใช้ร่วมกันคือ Hybrid Search (BM25 + Vector) ก่อน Rerank และ Query Rewriting ด้วย LLM เพื่อปรับคำถามให้เหมาะกับการค้นหา

เปรียบเทียบโมเดล Reranker ยอดนิยม 2026

| โมเดล | Provider | Deployment | ภาษาไทย | ราคา |

|-------|----------|-----------|--------|------|

| Cohere Rerank 3.5 | Cohere (API) | Cloud เท่านั้น | รองรับ | ~$2/1K queries |

| BGE-Reranker-v2-M3 | BAAI (Open Source) | Self-host ได้ | รองรับดีมาก | ฟรี (GPU) |

| Jina Reranker v2 | Jina AI (API/OSS) | Hybrid | รองรับ | $0.02/1M tokens |

| MixedBread mxbai-rerank | MixedBread AI | Self-host (OSS) | ปานกลาง | ฟรี |

| Voyage Rerank 2 | Voyage AI (API) | Cloud | จำกัด | ~$0.05/1K queries |

คำแนะนำสำหรับ SME ไทย: หากต้องการ Self-Host เพื่อควบคุมต้นทุนและ Privacy ให้ใช้ BGE-Reranker-v2-M3 ซึ่งเป็น Open Source รองรับภาษาไทยได้ดีที่สุด ถ้าต้องการ Speed-to-Market และไม่มีทีม MLOps ให้ใช้ Cohere Rerank 3.5 ผ่าน API

วิธี Implement Reranker กับ RAG Pipeline (Python + LangChain)

ตัวอย่าง code สำหรับเพิ่ม Reranker เข้าไปใน RAG pipeline ที่มีอยู่เดิม

ข้อควรระวัง: Cross-Encoder มี Context Length จำกัด (เช่น 512-8192 tokens) หากเอกสารยาวมาก ควรทำ Chunking ให้เหมาะสมก่อน และ cache ผลลัพธ์ของคำถามที่พบบ่อยเพื่อลดต้นทุน

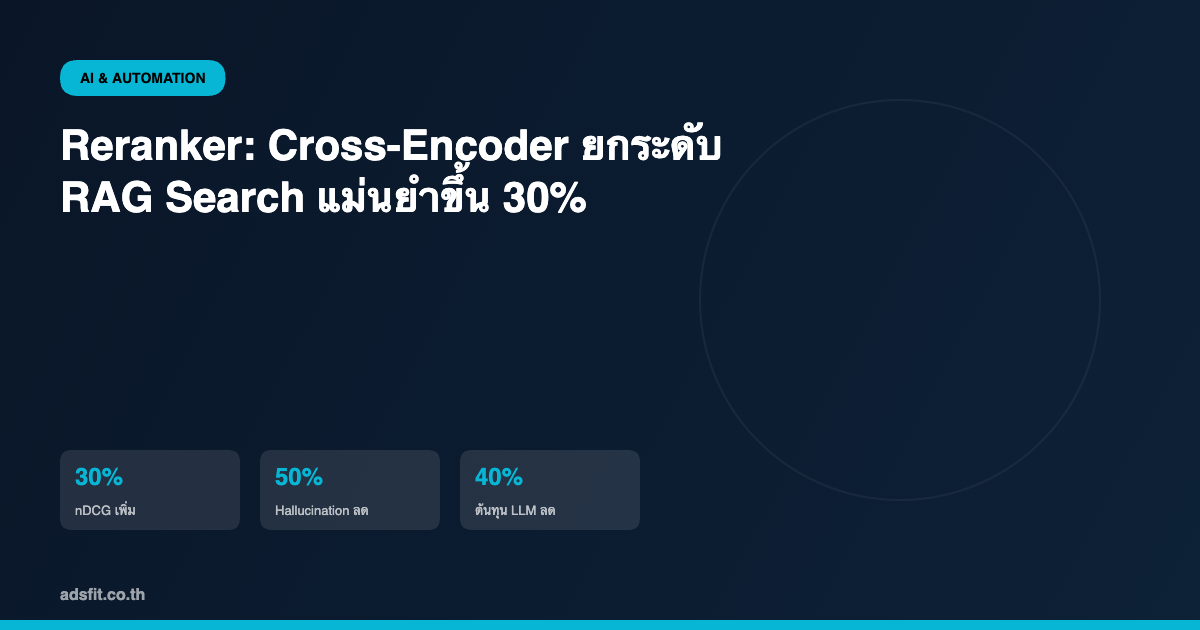

ผลลัพธ์ที่คาดหวัง: ตัวเลขจากงานวิจัยและ Production

การใส่ Reranker ในระบบ RAG มักให้ผลลัพธ์ดังนี้

Use Case ที่เหมาะกับ Reranker สำหรับ SME ไทย

Reranker เหมาะกับระบบ AI ที่ต้องการความแม่นยำสูง เช่น

สรุปและ Call to Action

Reranker ไม่ใช่ของเล่นใหม่ แต่คือ "ตัวเปลี่ยนเกม" ที่ยกระดับ RAG จากระบบที่ "ตอบเกือบถูก" ไปเป็นระบบที่ "ตอบตรงประเด็น" ด้วยการเพิ่มขั้นตอน Cross-Encoder หลัง Vector Search เพียงครั้งเดียว องค์กรของคุณจะได้ AI ที่แม่นยำขึ้นอย่างเห็นได้ชัด ลด Hallucination และประหยัดต้นทุน LLM ไปพร้อมกัน

Key Takeaways

หากทีมของคุณกำลังมองหาพันธมิตรที่ช่วยออกแบบและติดตั้งระบบ RAG พร้อม Reranker ที่ปลอดภัย เข้าใจบริบทธุรกิจไทย และรองรับ PDPA ทีม ADS FIT พร้อมให้คำปรึกษา [ติดต่อเรา](https://www.adsfit.co.th/#contact) หรืออ่านบทความที่เกี่ยวข้องเกี่ยวกับ RAG Evaluation, GraphRAG และ Vector Database เพิ่มเติมได้ที่ [บล็อกของเรา](https://www.adsfit.co.th/blog)